ChatGPT Plusに入っているのに、n8nからAIを呼ぼうとしたらAPIキーを求められて止まった。

この時点で、多くの人は「自分の設定が悪い」と考えます。

しかし、そこで詰まっている原因は設定ミスではありません。ChatGPTのサブスク、OpenAI API、ローカルLLMは、そもそも使う場所も料金の仕組みも違う別物です。

ここを混同したままAI自動化に進むと、月額課金しているのに自動化で使えない、API課金がどこで発生しているかわからない、ローカルLLMなら無料で代替できると勘違いする、という順番で止まります。

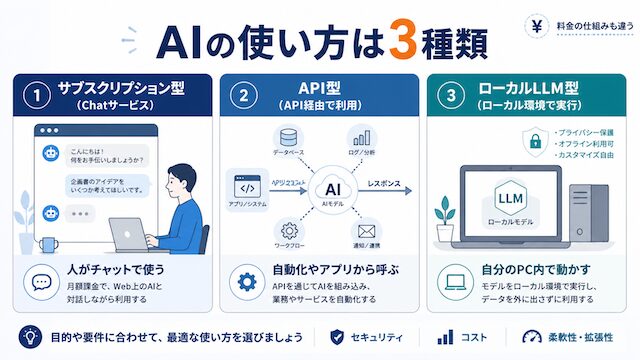

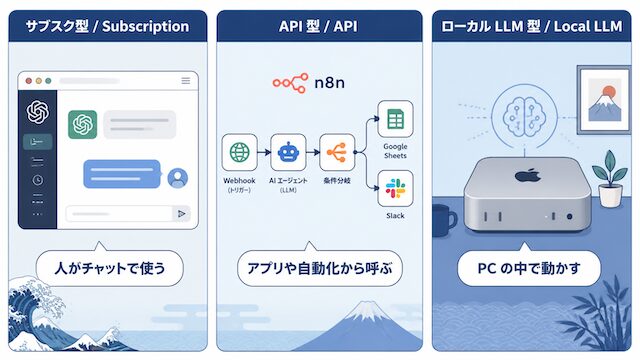

この記事では、AIの使い方を「サブスク型」「API型」「ローカルLLM型」の3つに分けて整理します。ChatGPT、n8n、Ollama、LM Studio、GPT-OSSを同じ土俵で見ず、それぞれをどこで使うものなのか、どんな場面で選ぶべきなのかを判断できる状態にするための記事です。

AIの料金で混乱した人へ

AIを使い始めた人が最初にぶつかる壁は、性能や使い方ではなく「料金体系」です。ChatGPT Plus に月額を払っているのに、自動化ツールから呼ぼうとしたら「API キーが必要です」と言われて止まってしまった、という相談をよくいただきます。

この記事はそうした混乱を、まず一段階上の地図から整理することを目的にしています。

「ChatGPT Plusに入っているのにn8nが動かない」がよく起きる

n8n のような自動化ツールから AI を呼びたいときに最初に詰まるのが、サブスクと API の境界です。ChatGPT Plus はあくまで chatgpt.com のチャット画面のためのサブスクで、自動化ツールから呼び出す権限は含まれていません。Plus の契約と API 利用は完全に別の勘定で、Plus に入っていても n8n のワークフローからは一切呼べないという仕様になっています。

これを知らないまま、自動化を組もうとして「Plus に入ったのにエラーが出る」と止まる人が後を絶ちません。

AIの使い方は3種類ある

AI を実務で使うときの形は、おおまかに次の 3 種類に分かれます。

サブスク型:ChatGPT Plus / Claude Pro / Gemini Advanced

サブスク型は、ブラウザやアプリのチャット画面で AI と対話するための月額プランです。ChatGPT Plus、Claude Pro、Gemini Advanced などが代表例で、月額は 20 ドル前後の固定料金です。文字数や回数の細かい上限はありますが、個人が日常的に使う範囲であれば追加課金は発生しません。

向いているのは、文章作成・調査・壁打ち・要約といった対話用途です。逆に、自動化ツールやアプリに組み込む用途には使えません。

API型:OpenAI API / Claude API / Gemini API

API 型は、自分のコードや自動化ツール(n8n など)から AI を呼び出すための仕組みです。OpenAI API、Claude API、Gemini API などが代表例で、料金はトークン(入出力の文字単位)ごとの従量課金になります。使った分だけ請求が来るため、月額の固定費はかからない代わりに、使いすぎれば青天井になり得ます。

向いているのは、業務自動化・システム組み込み・大量バッチ処理・アプリへの AI 機能搭載などです。

ローカルLLM型:Ollama / LM Studio / GPT-OSS

ローカル LLM 型は、AI モデル本体を自分の PC やサーバーにダウンロードして動かす方式です。Ollama、LM Studio、GPT-OSS(OpenAI が公開したオープンウェイトモデル)などが代表例で、ソフト自体は無料ですが、動かすためのハードウェア(メモリの大きい Mac mini、GPU 付き PC など)が必要です。一度動かせる環境を作ってしまえば、推論ごとの課金は発生せず、電気代のみで運用できます。

向いているのは、定型処理を大量に回したい人、機密情報を外部送信したくない人、ハードを既に持っている人です。

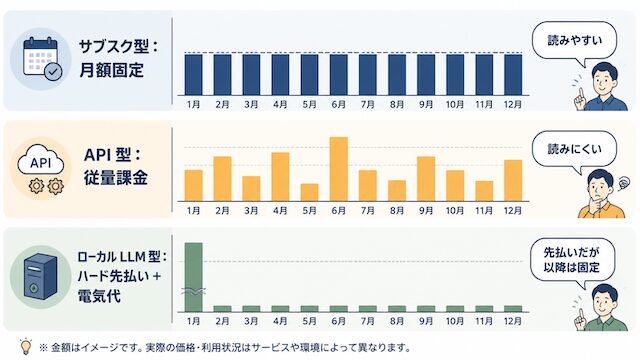

3形態を1枚で並べる比較表

3 形態の違いを一枚で並べると、得意分野とお金のかかり方の差が見えやすくなります。

| 項目 | サブスク型 | API 型 | ローカル LLM 型 |

|---|---|---|---|

| 使い方 | ブラウザ・アプリ上でチャット | コードや自動化ツール(n8n 等)から呼び出す | PC 上でモデルを直接動かす |

| 代表例 | ChatGPT Plus / Claude Pro / Gemini Advanced | OpenAI API / Claude API / Gemini API | Ollama / LM Studio / GPT-OSS |

| 主な用途 | 個人の文章作成・調査・対話 | 業務自動化・システム組み込み・バッチ処理 | 定型処理の自動化・プライバシー重視の処理 |

| お金のかかり方 | 月額固定(20 ドル前後) | トークン従量課金(使った分だけ) | 初期ハード投資 + 電気代 |

| 月額の見通し | 固定で読める | 使い方しだいで変動する | ハードを持っていれば実質変動なし |

向いている人・向いていない人

| 形態 | 向いている人 | 向いていない人 |

|---|---|---|

| サブスク型 | AI を日常的にチャットで使う個人・ビジネスパーソン | 自動化やシステム組み込みが目的の人 |

| API 型 | 業務自動化・アプリ開発・大量処理が必要なエンジニア・事業者 | 月額コストが予測しにくいことに抵抗が強い人 |

| ローカル LLM 型 | 対応ハードを既に持ち、定型処理を課金なしで回したい人 | 新規でハード購入が必要かつ使用頻度が低い人、高品質生成が必要な人 |

「自分のやりたいことはチャットで完結するか、それとも自動化に組み込みたいか」をまず切り分けるだけでも、選ぶべき形態は半分まで絞り込めます。

一般人が誤解しやすい4つのポイント

ここからは、サポート時によく出会う誤解を 4 つ取り上げます。先に正しい地図を持っておくと、無駄な課金や時間を防げます。

誤解1:ChatGPT Plusに入れば自動化にも使える

これは最も多い誤解です。ChatGPT Plus は chatgpt.com のチャット画面で使うためのサブスクで、API 利用権は含まれていません。n8n や自作スクリプトから AI を呼びたい場合は、Plus とは別に OpenAI API のアカウント登録と課金設定が必要です。

「Plus に課金しているのだから自動化でも使えるはず」という発想で組み立て始めると、API キーの発行段階で必ず詰まります。サブスクと API は別勘定だと最初に覚えてしまうのが近道です。

誤解2:APIは初回クレジットがあるから無料

OpenAI も Anthropic も、初回登録時に無料クレジット(数ドルから数十ドル相当)を付与する場合があります。この期間に「API は無料で使える」と勘違いすると、クレジットが切れた後の本番課金に気づかないままワークフローを動かし続けてしまいます。

特に n8n のような常時稼働するワークフローを組んでいる場合、課金開始の瞬間に気づかないまま月末を迎えるリスクがあります。API を使い始めるときは、ダッシュボードで残クレジットと請求設定を最初に確認するクセをつけてください。

誤解3:月額を払えばAPIも使い放題

これも誤解です。サブスク(Plus 等)と API 料金は完全に別の財布です。ChatGPT Plus に月額 20 ドル払っていても、API は別途トークン従量課金が発生します。

「もう月額払っているのにまた請求されるの」という感覚は自然ですが、Plus はチャット画面の利用権、API は呼び出し権という違う商品を買っている、と整理してください。

誤解4:ローカルLLMは完全無料

ローカル LLM のソフト(Ollama、LM Studio など)は無料で配布されています。しかし、モデルを動かす PC が必要です。Mac mini M4(16GB)であれば約 9 万円の投資が必要になり、これは事実上「先払いの固定費」です。さらに、品質面ではフロンティアモデル(GPT-4o、Claude Sonnet など)に比べて 1 から 2 世代分の差があります。

「無料で同じことができる」ではなく「ハード投資と品質妥協と引き換えに、推論の従量課金がゼロになる」という整理が正確です。

用途別の使い分け

3 形態の違いを踏まえて、よくあるユースケースごとに最適な選び方を整理します。

毎日チャットで文章作成・調査

毎日 AI と対話しながら文章を書いたり調査したりする使い方は、サブスク型が最も合理的です。月額固定で使い放題、UI が完成しており、画像生成や Web 検索などの付加機能もそのまま使えます。チャット用途であれば、わざわざ API 型に切り替えるメリットはほとんどありません。

n8nでメール・記事を自動処理

n8n などの自動化ツールから AI を呼ぶ場合は、API 型かローカル LLM 型のどちらかになります。サブスク型は構造的に呼び出せません。

「とにかく動かしたい」「処理量が少ない」段階であれば API 型から始めるのが導入コストとしては最小です。処理量が多くなってきて月額が読めなくなった段階で、ローカル LLM 型を検討する流れが自然です。

大量バッチ処理・社内機密の処理

大量の記事やメールを一括処理する用途、あるいは社内の機密情報を扱う用途では、ローカル LLM 型の優位が出やすくなります。バッチ処理は処理件数に比例して API 課金が膨らむため、固定費化できるローカルが有利になります。機密情報については、外部サーバーに送信しないという一点だけでローカルを選ぶ理由になります。

ただし、ローカル LLM で扱える品質は定型処理向きです。高品質な日本語生成や複雑な推論を必要とするタスクには向きません。

アプリ・システムへの組み込み

自分のアプリやサービスに AI 機能を組み込む場合は、基本的に API 型一択です。サブスク型は仕様上組み込めず、ローカル LLM 型はユーザー側のマシンに依存するため不特定多数向けの提供には向きません。エンドユーザーに AI 機能を提供したい場合は、API 型でコスト設計を行うのが標準ルートです。

n8n自動化で問題になるのは「APIの従量課金」

自動化に踏み込んだ人が最初にぶつかる現実的な壁は、API の従量課金です。

ChatGPT Plusはn8nから呼べない

繰り返しになりますが、n8n のワークフローから AI を呼ぶには API 接続が必要です。ChatGPT Plus は API 呼び出しに対応していません。Ollama などのローカル LLM も含めて、n8n と接続するには「API として呼べるエンドポイント」を用意する必要があります。

n8n の HTTP Request ノードで OpenAI API を呼ぶ最小設定は次のようなイメージです(n8n の OpenAI ノードを使う方法もありますが、ここでは構造をわかりやすくするため HTTP Request ノードでの例を示します)。

{

"method": "POST",

"url": "https://api.openai.com/v1/chat/completions",

"authentication": "predefinedCredentialType",

"credentialType": "openAiApi",

"sendHeaders": true,

"headerParameters": {

"parameters": [

{ "name": "Content-Type", "value": "application/json" }

]

},

"sendBody": true,

"bodyParameters": {

"parameters": [

{ "name": "model", "value": "gpt-4o-mini" },

{ "name": "messages", "value": "={{ [{ role: 'user', content: $json.input }] }}" }

]

}

}

このリクエストが実行されるたびに、入力と出力のトークン量に応じた課金が発生します。Plus に課金しているかどうかは関係なく、API キーに対して別途請求されます。

月いくらかかるかが事前に読めない

API 課金の最大のストレスは、月額が事前に読めないことです。処理量・モデル・プロンプト長・出力長が変動するため、「使ってみないとわからない」という感覚が常につきまといます。

具体的なコスト感(あくまで目安)として、gpt-4o-mini を使った Gmail 分類(1 日 30 通程度)であれば月数百円に収まる規模です。一方、ニュース要約や記事下処理を高頻度で回すと、月数千円台に跳ねることもあります。具体的な試算はシリーズ第 2 回で扱います。

この「使うほどかかる」感覚が積み重なると、心理的ストレスからローカル LLM への関心に直結します。

なぜローカルLLMが選択肢に出てくるのか

ローカル LLM が個人や個人事業者の選択肢に上がってくる背景には、技術的な理由よりも心理的な理由の方が大きく効いています。

「使うたび課金」の心理コストを取り除きたい

API の従量課金は、合理的に計算すれば月数百円から数千円に収まるケースが多いです。それでも「使うたびに課金される」という感覚は、自動化を試行錯誤するときの心理ブレーキになります。プロンプトを試行錯誤するたびに、ワークフローを動かすたびに、メーターが回る感覚です。

ローカル LLM は、この心理メーターをゼロにできます。ハードの初期投資を済ませてしまえば、何回呼び出しても電気代しかかかりません。「思いついたらすぐ試せる」という運用感が手に入ります。

ハードを既に持っているかが分岐点

費用対効果の観点では、対応ハードを既に持っているかどうかが最大の分岐点です。

Mac mini M4 などを既に手元に持っている場合、追加投資はゼロで Ollama を導入できます。月の API 節約額が 3,000 円程度でも、初月から費用対効果が成立します。

一方、新規でハードを購入する場合は損益分岐に時間がかかります。Mac mini M4(16GB)を 9 万円で購入し、月 5,000 円の API を節約するとして、損益分岐は約 18 ヶ月です。さらに、API 価格は 2025 年から 2026 年にかけて大幅に下落しており、新規購入の損益分岐はさらに遠のいている可能性があります。

つまり、ローカル LLM はハードを既に持っている人にとっての選択肢です。新規購入から始める場合は、心理コスト・プライバシー要件・大量処理の固定費化など、コスト以外の動機が必要になります。

参考までに、Ollama でモデルをダウンロードして簡単な推論を行うコマンドは次のようになります。

# Ollama 本体のインストール(macOS の場合) brew install ollama # Ollama サーバを起動(バックグラウンド) ollama serve & # 軽量モデルをダウンロードしてその場で対話を開始 ollama run gemma3:4b # プロンプト例(対話モードに入った後) # >>> 次の文を 80 文字以内で要約してください: ...

これだけで、追加の API 課金なしでモデルを動かせる状態になります。n8n からは Ollama ノード経由で同じモデルを呼び出せます。

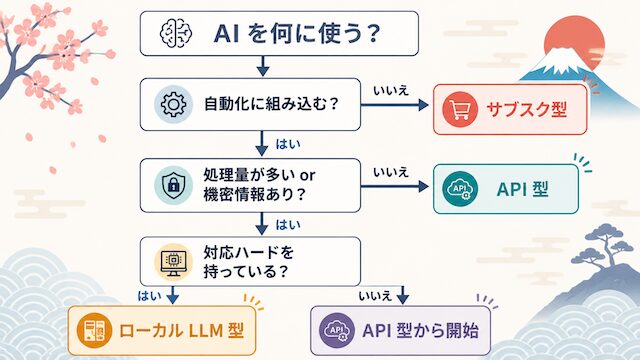

自分はどの型を使うべきか:判断手順

ここまでの内容を踏まえて、自分はどの形態を選ぶべきかを 3 ステップで決められるように整理します。

3ステップで決めるチェックリスト

ステップ 1:チャットで完結するか、自動化に組み込むかを切り分ける。チャットで完結するならサブスク型を選びます。自動化に組み込むなら次のステップに進みます。

ステップ 2:処理量と機密性を確認する。処理量が少なく機密性も標準であれば API 型から始めます。処理量が大きい、または機密情報を扱うのであれば、ローカル LLM 型を検討する余地が出てきます。

ステップ 3:ハードを既に持っているかを確認する。Mac mini M4 や GPU 付き PC を既に持っているならローカル LLM 型に進みます。新規購入が必要で、月の API 課金見込みが 5,000 円未満であれば、当面 API 型で運用するのが現実的です。

迷ったときの初期セットアップ案

判断に迷うときは、まずサブスク型と API 型の両方に小さく入ることをおすすめします。サブスク型はチャット作業の生産性を上げ、API 型は自動化の試作に使います。月の API 課金が継続的に膨らみ始めた時点で、ローカル LLM 型の検討を始めるという順序です。

最初からローカル LLM に飛びつくと、ハード選定・環境構築・品質調整に時間を取られすぎて、本来やりたかった自動化の前で止まってしまいがちです。

まとめ

ここまでで、AI の使い方には 3 種類あるという地図を共有しました。

3形態の整理を3行で復習

サブスク型は、チャット画面で AI と対話するための月額プランで、自動化には使えません。API 型は、自動化やシステムから AI を呼ぶための従量課金で、月額が事前に読みにくいのが弱点です。

ローカル LLM 型は、ハード投資と引き換えに推論を固定費化する選択肢で、ハード所持者にとっての実用解です。

関連事例と次のアクション

本記事で取り上げた 3 形態を、実際にどう組み合わせて運用しているかについては、Beエンジニアの実践事例をご参考ください。

/local-ai-environment-memo/ では、Mac mini でローカル AI 環境を構築した記録をまとめています。ハード選定からモデルの動作感までを実体験ベースで整理しているため、ローカル LLM 型を検討中の方の判断材料になります。

/ai-editor-rewrite-setup/ では、GA4・n8n・GPT を連携させて記事リライト候補を自動抽出する仕組みを紹介しています。API 型の AI を実運用に組み込んだときの構造例として参考になります。