検索結果から本当に知りたい情報が見つからないと思ったことはありませんか?

AIによる要約や自動生成が当たり前になった現在、検索に表示されるのは結論や形式の整った答えばかりです。なぜその内容に至ったのか、どのような前提や比較があったのかといった情報は、意図的に排除されつつあります。

こうした構造が進めば、情報の供給者が減少し、やがて検索やAIそのものの基盤が崩れていく可能性があります。

本記事では、この構造的変化と、それに対して発信者が取りうる立場について検討します。

AIが検索を支配する時代の構造的問題

AIが検索エンジンに深く組み込まれるようになり、検索結果のあり方が大きく変化しています。

これまでの検索は、リンクを通じて「誰がどのように考えたか」という流れを追えるものでした。

しかし現在では、AIが要約した“答え”だけが検索結果に表示され、ユーザーはリンク先に訪れることなく情報を取得できるようになっています。

この変化は一見便利に見えますが、情報の受け取り方や発信者の在り方に深刻な影響を及ぼしています。

検索が「答えの自動供給装置」と化したことで、情報の背景や意味が置き去りにされる事態が進行しているのです。

答えだけが検索され、意味は失われていく

今の検索は、「どんな文脈で語られたか」ではなく、「それっぽい結論」が早く提示される仕組みに変わっています。以下はその典型です。

- 企業のDX化とは → クラウド導入が重要です

- 地方創生 成功事例 → SNS活用がカギです

- 組織のマネジメント改善 → 心理的安全性の確保が必要です

- 環境問題 企業の対応策 → 再生可能エネルギーの導入です

これらは「水とは? → H₂O」と答えているのと同じです。 確かに正しいかもしれませんが、それだけでは何も伝わりません。冷たい水を飲んだ経験も、災害時に水を求めた切実さも、すべて削ぎ落とされています。

さらに近年は、GAFAM・ICBM・MISIといった略語が“知的な表現”として無批判に使われる傾向も加速しています。本来は概念の整理や説明のための言葉だったはずが、「略語=上流の思考様式」として扱われ、意味を伴わないまま使われています。

実際には何の略なのか、なぜその構造で語られるのかを理解しないまま“わかった気になる”情報ばかりが増えているのです。こうして検索結果は、答えらしき言葉と略語で埋め尽くされ、 人間の迷いや判断、経験や違和感といった“情報の本体”が見えなくなっていきます。

この傾向は、特にエンジニアの世界に顕著に現れています。

たとえば、喫茶店で「モーニングセットのお飲み物は何にしますか?」と尋ねられた際、 「デフォルトで」と返す光景です。

本来は自分で判断し、何を望むかを言葉にするべき場面でありながら、選択すら外注している状態です。この「デフォルトで」という感覚は、検索結果をそのまま受け入れる姿勢と本質的に同じです。

なぜそうするのか、他の可能性はあるのかといった検討を省き、最初から用意された“正しそうな何か”に乗っかる。この態度が常態化することで、思考の過程を持たない「コピーされた人間」が量産されていきます。

AIが整えた情報を疑うこともなく受け入れ、略語を理解せずに並べ、選ばれた答えをそのまま自分の言葉として使う―― 今、検索とAIによって社会全体が「思考の外部委託」に最適化されつつあります。

誰が言ったかではなく、何が言われたかだけが選ばれる

検索に出てくる文章は、誰が書いたかも、なぜそう言ったかも見えません。

ただ、言葉だけが浮いています。引用も、文脈も、背景もありません。それでも検索は「これが正しい」と言ってきます。

「この人がこう考えたから、この結論になった」という流れは切り捨てられ、「こう書いてあるから、これが正しい」という順番だけが残っています。それが何なのか、誰の責任で語られたのか、わからないまま。

名前のない文章が、どこからか現れて、正解の顔をして並んでいる。その正解は、誰の判断にも基づいていません。でも、検索の中ではそれで充分とされます。

その瞬間から、文章を書くという行為は、「誰かの言葉を届けること」ではなく、「検索に拾われる形に整えること」にすり替わります。

そして気づけば、“人が言ったこと”は消えて、“言われたこと”だけが残っていました。

情報供給者がいなくなれば、AIも消える

AIによる情報生成や検索要約が一般化する中で、「情報は自動で無限に出てくるもの」という錯覚が広がっています。

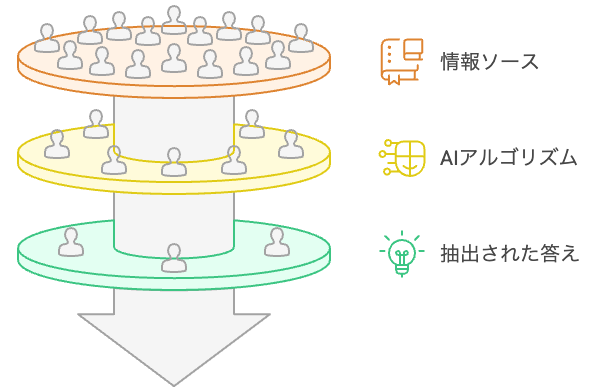

しかし、その背後には必ず“誰か”が作った文章や知識が存在しています。AIは、それらの膨大な学習データに基づいて生成を行っているだけであり、ゼロから情報を生み出しているわけではありません。

つまり、情報を提供する人間――文章を書き、考え、整理し、記録する発信者がいなければ、AIは成立しません。

どれだけ大規模なモデルであっても、元になる「思考の痕跡」がなければ、答えは作り出せないのです。

AIは他者の知識を前提に成立している

現在のAIは、インターネット上に存在する膨大なテキストデータをもとに学習しています。論文、ブログ、書籍、FAQ、議事録、コードコメントなど、人間が書いたあらゆる種類の情報が素材になっています。

これらの情報は、それぞれの発信者が自身の立場や状況、経験をもとにして記録してきたものであり、その積み重ねこそがAIの知能の土台です。

AIの出力は、あくまでその過去の情報を圧縮し、再構成したものにすぎません。つまり、過去に誰かが「書いた」という行為がなければ、AIが出せる答えの幅も深さも存在しないということです。

よく「AIが人間の仕事を奪う」と語られますが、実際にはそのAI自身が人間の仕事に依存しています。コード生成AIが動くには、過去のソースコードとその設計思想が必要です。文章生成AIが答えるには、過去に誰かが残した問いと議論の記録が必要です。

人間が知識を記録しなくなったとき、AIはそれ以上の“次の答え”を生み出せなくなります。

フリーライドが続けば、学習元が消滅する

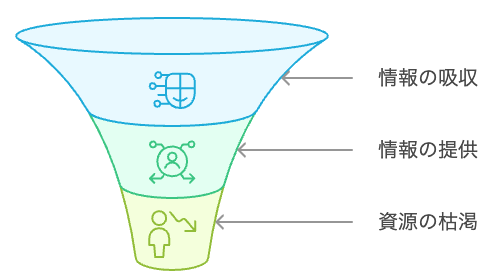

検索に表示される情報がAIによって要約され、その答えだけがクリックされるようになると、元の発信者は評価されなくなります。

アクセスは減り、収益は落ち、やがて発信自体が減少していきます。特にブログや解説系コンテンツ、オープンなQ&Aサイトなどはこの影響を強く受けています。

検索結果でAIが答えを表示してしまえば、ユーザーはリンク先へ訪れることなく問題を“解決した気”になります。その結果、元記事は読まれず、貢献も報酬も得られないまま放置されます。

この状態が続けば、情報提供者は消えていきます。そしてそのとき、AIは学習できる新しい知識を失い、事実上、AIの進化が止まります。

現在は過去に書かれた数十年分のデータが使えていますが、新たな供給が止まれば、AIの出力は陳腐化していきます。

この問題は、単なる公平性の話ではなく、情報システム全体の“自壊”につながる構造的な問題です。AIにとって情報は「使えるもの」ではなく「供給され続けなければならないもの」です。

人間の書き手が失われれば、AIはその直後から知能の再生産ができなくなります。

GAFAMも情報の循環がなければ維持できない

AIによる検索要約や自動生成が急速に普及する中で、その裏側にある“供給構造”のバランスが崩れ始めています。

ユーザーはAIによって整えられた回答を消費するだけになり、その答えの元となった情報源に触れる機会が減っています。

しかし、AIも検索も、そしてそのプラットフォームを提供しているGAFAMのような巨大企業も、実際には情報を供給し続ける個人や団体に依存して成り立っています。

情報を提供する側と消費する側の関係が切断されたとき、最も打撃を受けるのはAIではなく、そのAIを中核に据えた検索インフラ全体です。情報が循環しなければ、サービスもまた持続できません。

情報流通を支配する構造とその限界

GAFAMは検索、SNS、動画、メール、クラウドといったあらゆるプラットフォームを提供していますが、その中でやり取りされる情報の“中身”は、すべて外部の人間や組織が生み出したものです。

Googleの検索結果も、YouTubeの動画も、Metaのフィードも、情報を投稿するユーザーがいなければ成立しません。

つまり、GAFAMが本質的に持っているのは「情報を流通させる装置」であって、「情報そのものの生産能力」ではないのです。

たとえば、AIによる自動要約が検索結果に表示され、それだけでユーザーの疑問が解決した場合、元の記事や発信者のもとにアクセスは発生しません。検索は成立していますが、情報供給側にはリターンがありません。

この構造が続くと、情報を生産するインセンティブが消え、ネット空間から供給が減っていきます。すると次第にAIも学習対象を失い、プラットフォーム自体が“循環停止”状態に陥ります。

情報が回らなくなった検索サービスは、いずれ「過去の情報を並べるだけの装置」になり、価値を失っていくことになります。

持続可能な循環を取り戻すための設計転換

GoogleやOpenAIは、AIを用いた検索やチャットで「答えを直接出す」方向に舵を切っています。しかしこの動きは、情報提供者のモチベーションを下げ、検索基盤そのものを空洞化させるリスクを抱えています。

本来、検索とは情報の入り口であり、その先にある発信者の知識や経験に触れることが前提でした。それが要約で完結するようになれば、情報の流通ルートが短絡的になり、深さも広がりも失われます。

この構造は、検索エンジンだけでなく、広告収益や外部サイトとの連携を基盤にしているGAFAM全体に影響を及ぼします。検索から外部へ流れない、YouTubeから他メディアへ飛ばない、ChatGPTで答えが出て終わる――こうした“循環を断つ最適化”が進むほど、情報の生成側も減っていきます。

本来であれば、プラットフォームは「引用元へのトラフィック還元」や「学習元への報酬分配」といった構造を設計する必要があります。それを怠れば、今はうまく機能しているように見えるAIや検索が、10年後にはただの“死んだ文書の検索機”になっているかもしれません。

情報は自動で湧いてくるものではなく、人が記録し、言葉にし、構造を整理する行為の積み重ねによって供給されています。その当たり前の循環が途切れたとき、プラットフォームの中身は一気に薄れていきます。

GAFAMがこの構造の脆さに気づいていないとは考えられません。むしろ彼らは、この問題に最も早く気づいている存在です。情報供給が止まれば、自分たちの検索もAIも成立しないことを理解しているからです。

おそらくすでに、水面下では「情報提供者への還元構造」が設計されつつあるはずです。検索の中で引用された発信元に対して報酬を与える仕組み、要約に使われた元記事への接続性を強化する技術――そのようなインフラが静かに準備されている可能性があります。

問題は、それが公開されたときに“接続できる立場”にいられるかどうかです。引用される構造を持ち、意味を残してきた発信者だけが、次の情報循環に組み込まれていくことになるでしょう。

価値を持つのは、意味を構成できる発信だけ

情報の量が増え続ける中で、AIはその全体を平面化し、同じような答えを返すようになりました。

検索しても、出てくるのは・・

- 「クラウド導入が重要です」

- 「再生可能エネルギーの活用です」

- 「リスキリングが鍵です」

- 「ジェンダー平等が求められます」

- 「ユーザー目線の設計が重要です」

- 「〇〇スクールはこちら」

- 「無料登録はこちら」

など、誰でも言える無難な断片ばかりです。そこに「誰が」「なぜそう言ったのか」「どうしてそうなったのか」という文脈はありません。

この流れの中で、発信する人間が価値を持つ条件は大きく変わりました。

ただの知識やノウハウでは残れません。今後残るのは、意味を再構成できる発信だけです。

判断と構造を言語化できる人間が残る

検索の表層に現れる情報は、すべてが「答え」だけになってきています。ですが、検索する人間が本当に求めているのは、なぜその答えにたどり着いたのか、その過程です。

意味が希薄な発信ではなく、前提・選択肢・判断の流れをきちんと示し、「なぜこう考えるのか」という構造を持つ言葉だけが残っていきます。

読み手も、それを無意識に求めています。AIが要約する断片にはもう飽きているのです。読みたいのは、“答え方の型”ではなく、“答えにたどり着くまでの風景”です。

昔はひとつの会社に長く勤めることが評価されていましたが、今は「どれだけ多くの企業で何を経験してきたか」が価値とみなされます。

これは、知識そのものよりも「経験の数と意味づけ」に重きが置かれているという流れを示しています。この傾向は今後さらに強まり、発信の世界でも“経験を構成できる人間”だけが価値を持つ時代へと移っていくのです。

他人の経験に意味を見出せる発信だけが接続される

人は、並列に並べられた情報群の中で、「この人はなぜこう判断したのか?」という違和感にこそ惹かれます。それが感情であり、経験です。

AI検索がいかに整っていても、経験の重みを再現することはできません。なぜなら、そこに人間の文脈が必要だからです。

- 「なぜそのとき、そう判断したのか?」

- 「どのような経験が、その選択を導いたのか?」

この“空白”を埋める力だけが、AI時代における人間の価値です。そしてこの価値は、いずれ検索エンジンの設計思想そのものに影響を与えます。

検索エンジンの未来は、「知識の量」ではなく「経験の構成力」を重視するようになるでしょう。なぜなら、人が求めているのは、情報ではなく「他者の判断の根拠」だからです。

そしてこの構造を支えるには、情報提供者への報酬還元システムが不可欠です。

意味を提供する者が、無報酬で消耗し続ける構造は持続できません。逆に言えば、そこに還元の仕組みを持つ新たな検索サービスが現れる可能性は極めて高いと言えます。

歴史が証明してきたように、支配構造の裏側から現れる何かが、その仕組みに風穴を開けます。それは無名のスタートアップかもしれません。その新たな構造に接続できる発信だけが、“次”に残流のだと思います。